MapReduce案例-分布式缓存共享数据

我们可以使用Hadoop DistributedCache(分布式缓存)来分发只读的、基于文件的资源给Map和Reduce任务。 这些资源可以是简单的数据文件、档案文件(archives)或Mapper/Reducer执行计算所需的JAR文件。

问题描述

下面我们对HTTP服务器日志项进行分析。 这里我们假定一个日志项由五部分组成:request host、timestamp、request URL、response size和HTTP状态码。如下所示:

192.168.0.2 - - [01/Jul/1995:00:00:01 -0400] "GET /history/apollo/HTTP/1.0" 200 6245

其中:

- 199.72.81.55 客户端用户的ip

- 01/Jul/1995:00:00:01 -0400 访问的时间

- GET HTTP方法,GET或POST

- /history/apollo/ 客户请求的URL

- 200 响应码 404

- 6245 响应内容的大小

要求:解析用户访问日志记录,找出用户来源分布。

输出数据格式如下:"上海市 7"。

上海市 7 北京市 3 广州市 7 成都市 2 深圳市 2 ......

实现思路

Hadoop在执行任何job的task之前,会先拷贝文件到分布式缓存到所有的工作节点。对于每个job,DistributedCache只拷贝这些文件一次。

我们在Mapper或Reducer的setup()方法中解析和加载来自DistributedCache的数据。

一、创建Java Maven项目

Maven依赖:

<?xml version="1.0" encoding="UTF-8"?>

<project xmlns="http://maven.apache.org/POM/4.0.0"

xmlns:xsi="http://www.w3.org/2001/XMLSchema-instance"

xsi:schemaLocation="http://maven.apache.org/POM/4.0.0 http://maven.apache.org/xsd/maven-4.0.0.xsd">

<modelVersion>4.0.0</modelVersion>

<groupId>HadoopDemo</groupId>

<artifactId>com.xueai8</artifactId>

<version>1.0-SNAPSHOT</version>

<dependencies>

<!--hadoop依赖-->

<dependency>

<groupId>org.apache.hadoop</groupId>

<artifactId>hadoop-common</artifactId>

<version>3.3.1</version>

</dependency>

<!--hdfs文件系统依赖-->

<dependency>

<groupId>org.apache.hadoop</groupId>

<artifactId>hadoop-hdfs</artifactId>

<version>3.3.1</version>

</dependency>

<!--MapReduce相关的依赖-->

<dependency>

<groupId>org.apache.hadoop</groupId>

<artifactId>hadoop-mapreduce-client-core</artifactId>

<version>3.3.1</version>

</dependency>

<dependency>

<groupId>org.apache.hadoop</groupId>

<artifactId>hadoop-mapreduce-client-jobclient</artifactId>

<version>3.3.1</version>

</dependency>

<!--junit依赖-->

<dependency>

<groupId>junit</groupId>

<artifactId>junit</artifactId>

<version>4.12</version>

<scope>test</scope>

</dependency>

</dependencies>

<build>

<plugins>

<!--编译器插件用于编译拓扑-->

<plugin>

<groupId>org.apache.maven.plugins</groupId>

<!--指定maven编译的jdk版本和字符集,如果不指定,maven3默认用jdk 1.5 maven2默认用jdk1.3-->

<artifactId>maven-compiler-plugin</artifactId>

<configuration>

<source>1.8</source> <!-- 源代码使用的JDK版本 -->

<target>1.8</target> <!-- 需要生成的目标class文件的编译版本 -->

<encoding>UTF-8</encoding><!-- 字符集编码 -->

</configuration>

</plugin>

</plugins>

</build>

</project>

LogProcessorMapper.java

Mapper类。在该类的setup方法中,读取分布式缓存中的共享数据文件,保存到内存中的HashMap中。

package com.xueai8.distcache;

import java.io.*;

import java.net.URI;

import java.util.HashMap;

import java.util.regex.Matcher;

import java.util.regex.Pattern;

import org.apache.hadoop.fs.FSDataInputStream;

import org.apache.hadoop.fs.FileSystem;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.IntWritable;

import org.apache.hadoop.io.LongWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Mapper;

import org.apache.hadoop.util.StringUtils;

import org.slf4j.Logger;

import org.slf4j.LoggerFactory;

public class LogProcessorMapper extends Mapper<LongWritable, Text, Text, IntWritable> {

private static final Logger logger = LoggerFactory.getLogger(LogProcessorMap.class);

private static final Text outKey = new Text(); // key

private static final IntWritable one = new IntWritable(1); // value

// 存储解析后的ip与城市名映射关系

private HashMap<String,String> ipWithCity = new HashMap<>();

@Override

public void setup(Context context) throws IOException {

// 获取缓存文件uri

URI[] localCachePath = context.getCacheFiles();

// URI[] localCachePath = Job.getInstance(context.getConfiguration()).getCacheFiles();

logger.info("localCachePath[0]: " + localCachePath[0]);

Path patternsPath = new Path(localCachePath[0].getPath());

String patternsFileName = patternsPath.getName();

parseSkipFile(patternsFileName);

}

// 自定义方法,用来读取分布式缓存中的共享数据文件

private void parseSkipFile(String fileName) {

try {

// 读取缓存文件中的ip-city映射数据,保存到内存hash map中

BufferedReader br = new BufferedReader(new FileReader(fileName));

String line;

while ((line = br.readLine()) != null) {

String[] items = line.split("\t");

// items[1] = new String(items[1].getBytes("iso-8859-1"),"utf-8");

logger.info(items[0] + "," + items[1]);

// 保存到内存hash map中

ipWithCity.put(items[0], items[1]); // (ip, city)

}

} catch (IOException ioe) {

System.err.println("当解析缓存文件时出现异常:'" + fileName + "' : "

+ StringUtils.stringifyException(ioe));

}

}

@Override

public void map(LongWritable key, Text value, Context context)

throws IOException, InterruptedException {

// 正则表达式

String logEntryPattern = "^(\\S+) (\\S+) (\\S+) \\[([\\w:/]+\\s[+\\-]\\d{4})\\] \"(.+?)\" (\\d{3}) (\\d+)";

Pattern p = Pattern.compile(logEntryPattern);

Matcher matcher = p.matcher(value.toString());

if (!matcher.matches()) {

System.err.println("损坏的记录 : " + value);

return;

}

// 抽取各个字段

String userIP = matcher.group(1);

// 根据ip 获取相应的 city

if(ipWithCity.get(userIP) != null) {

userIP = ipWithCity.get(userIP);

}else{

return;

}

// 写出 (ip, LogWritable)

outKey.set(userIP);

context.write(outKey,one);

}

}

LogProcessorReducer.java:

Reducer类。在这里对来自同一个城市的用户数量进行统计汇总。

package com.xueai8.distcache;

import java.io.IOException;

import org.apache.hadoop.io.IntWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Reducer;

public class LogProcessorReducer extends Reducer<Text, IntWritable, Text, IntWritable> {

private IntWritable result = new IntWritable(0);

public void reduce(Text key, Iterable<IntWritable> values, Context context)

throws IOException, InterruptedException {

int sum = 0;

for (IntWritable val : values) {

sum += val.get();

}

result.set(sum);

context.write(key, result);

}

}

LogProcessorDriver.java:

驱动程序类,用于将作业提交到Hadoop上执行。

package com.xueai8.distcache;

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.conf.Configured;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.IntWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;

import org.apache.hadoop.util.GenericOptionsParser;

import org.apache.hadoop.util.Tool;

import org.apache.hadoop.util.ToolRunner;

/*

* 共享资源:ip2locale.txt

* 199.120.110.21 北京市

* 199.72.81.55 上海市

* 205.189.154.54 广州市

* 205.212.115.106 深圳市

* 129.94.144.152 成都市

*/

public class LogProcessorDriver extends Configured implements Tool {

public static void main(String[] args) throws Exception {

int res = ToolRunner.run(new Configuration(), new LogProcessorDriver(), args);

System.exit(res);

}

@Override

public int run(String[] args) throws Exception {

GenericOptionsParser optionParser = new GenericOptionsParser(getConf(), args);

String[] remainingArgs = optionParser.getRemainingArgs();

if (remainingArgs.length != 2) {

System.err.println("用法:<input_path> <output_path>");

System.exit(-1);

}

Job job = Job.getInstance(getConf(), "log-analysis");

// 添加指定资源到分布式缓存

job.addCacheFile(new Path("/data/mr/ip2locale.txt").toUri());

job.setJarByClass(LogProcessorDriver.class);

job.setMapperClass(LogProcessorMapper.class);

job.setReducerClass(LogProcessorReducer.class);

job.setOutputKeyClass(Text.class);

job.setOutputValueClass(IntWritable.class);

FileInputFormat.setInputPaths(job, new Path(args[0]));

FileOutputFormat.setOutputPath(job, new Path(args[1]));

boolean flag = job.waitForCompletion(true);

return (flag ? 0 : 1);

}

}

二、配置log4j

在src/main/resources目录下新增log4j的配置文件log4j.properties,内容如下:

log4j.rootLogger = info,stdout

### 输出信息到控制抬 ###

log4j.appender.stdout = org.apache.log4j.ConsoleAppender

log4j.appender.stdout.Target = System.out

log4j.appender.stdout.layout = org.apache.log4j.PatternLayout

log4j.appender.stdout.layout.ConversionPattern = [%-5p] %d{yyyy-MM-dd HH:mm:ss,SSS} method:%l%n%m%n

三、项目打包

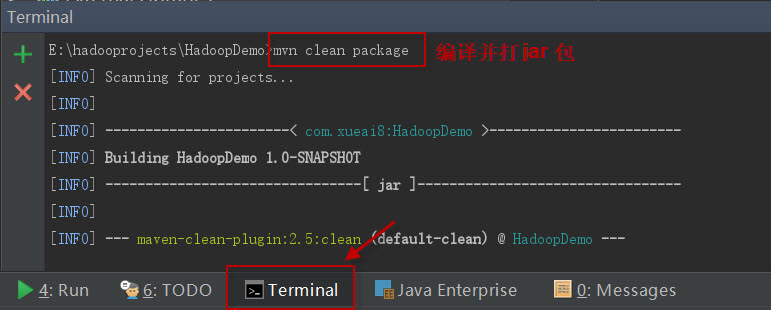

打开IDEA下方的终端窗口terminal,执行"mvn clean package"打包命令,如下图所示:

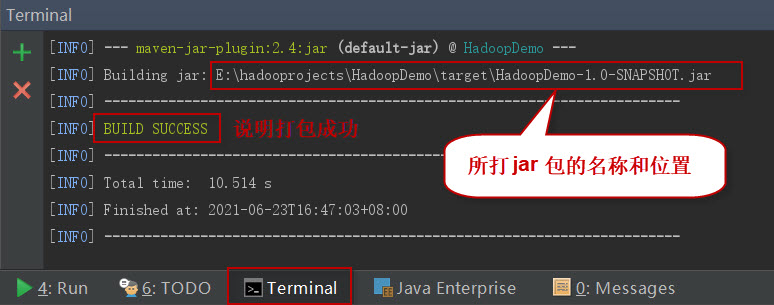

如果一切正常,会提示打jar包成功。如下图所示:

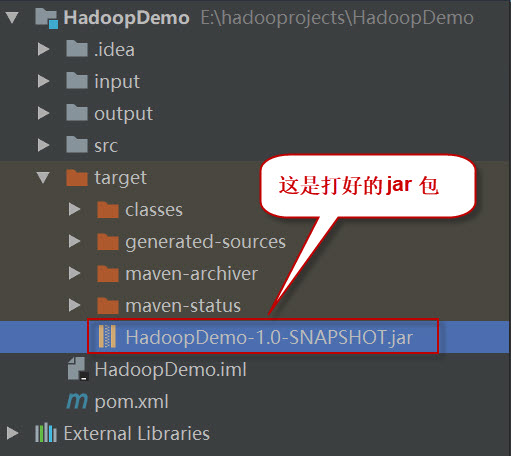

这时查看项目结构,会看到多了一个target目录,打好的jar包就位于此目录下。如下图所示:

四、项目部署

请按以下步骤执行。

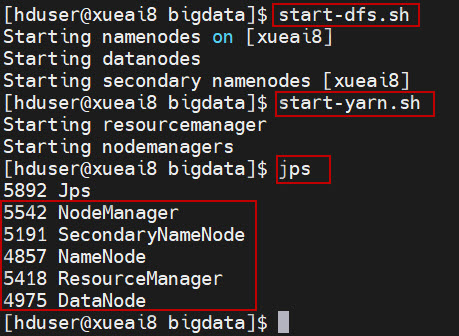

1、启动HDFS集群和YARN集群。在Linux终端窗口中,执行如下的脚本:

$ start-dfs.sh

$ start-yarn.sh

查看进程是否启动,集群运行是否正常。在Linux终端窗口中,执行如下的命令:

$ jps

这时应该能看到有如下5个进程正在运行,说明集群运行正常:

5542 NodeManager

5191 SecondaryNameNode

4857 NameNode

5418 ResourceManager

4975 DataNode

2、将日志文件log_sample.txt和共享文件ip2locale.txt上传到HDFS的/data/mr/目录下。

$ hdfs dfs -mkdir -p /data/mr $ hdfs dfs -put log_sample.txt /data/mr/ $ hdfs dfs -put ip2locale.txt /data/mr/ $ hdfs dfs -ls /data/mr/

3、提交作业到Hadoop集群上运行。(如果jar包在Windows下,请先拷贝到Linux中。)

在终端窗口中,执行如下的作业提交命令:

$ hadoop jar com.xueai8-1.0-SNAPSHOT.jar com.xueai8.distcache.LogProcessorDriver /data/mr/log_sample.txt /data/mr-output

4、查看输出结果。

在终端窗口中,执行如下的HDFS命令,查看输出结果:

$ hdfs dfs -ls /data/mr-output

可以看到如下的输出结果:

上海市 7 北京市 3 广州市 7 成都市 2 深圳市 2